0%

JCT削減

0%

スループット向上

0

GPUスケーラビリティ

0%

エネルギー効率向上

LLM推論の3つのボトルネック

DeepSeek V4などの超大規模モデルが兆パラメータを超える中、従来のGPU + DRAMアーキテクチャはメモリ容量、ストレージ帯域幅、運用コストの3つのボトルネックに直面しています。

メモリウォール

671Bパラメータモデルは1.2TB+のメモリが必要。単一ノードのGPU HBM容量は大幅に不足し、KV-Cacheはコンテキスト長と共に線形に增大します。

ストレージ帯域幅

Prefill段階ではSSDから数百GBのモデル重みをロードする必要があり、従来の単一パスPCIe帯域幅が主要なボトルネックとなります。

運用コスト

大規模GPUクラスタの電力と冷却コストが上昇し続け、トークンあたりの推論コストを商業的に実行可能なレベルまで下げるのが困難です。

CORE TECHNOLOGIES

3つのコア技術の柱

FFI8805 Premiumは3つのブレークスルー技術を統合し、モデルメモリ、データパス、ストレージメディア全体でLLM推論を最適化します。

PILLAR 1 · MODEL MEMORY

DeepSeek V4 Engram 永続メモリエンジン

EngramはDeepSeek V4が導入したネイティブ永続メモリ機構で、高頻度知識をO(1)クエリ可能な構造化メモリに圧縮し、KV-Cacheの線形成長を置き換えます。

O(1)

メモリクエリ複雑度

14.8T

トレーニングトークン

5.2×

メモリ圧縮率

671B

モデルパラメータ

V4 vs V3 ベンチマーク向上

MMLU+3.4

BBH+5.0

HumanEval+3.0

MATH+2.4

Multi-Query NIAH+12.8

PILLAR 2 · DATA PATH

DualPath 帯域幅最適化

DualPathはAIトレーニングクラスタのアイドルDEノードSNICを活用し、SSD→DE DRAM→CNIC RDMA→GPUの第2データパスを開きます。

45.62%

JCT削減

2.25×

スループット向上

1,152

GPUスケール

PILLAR 3 · STORAGE MEDIA

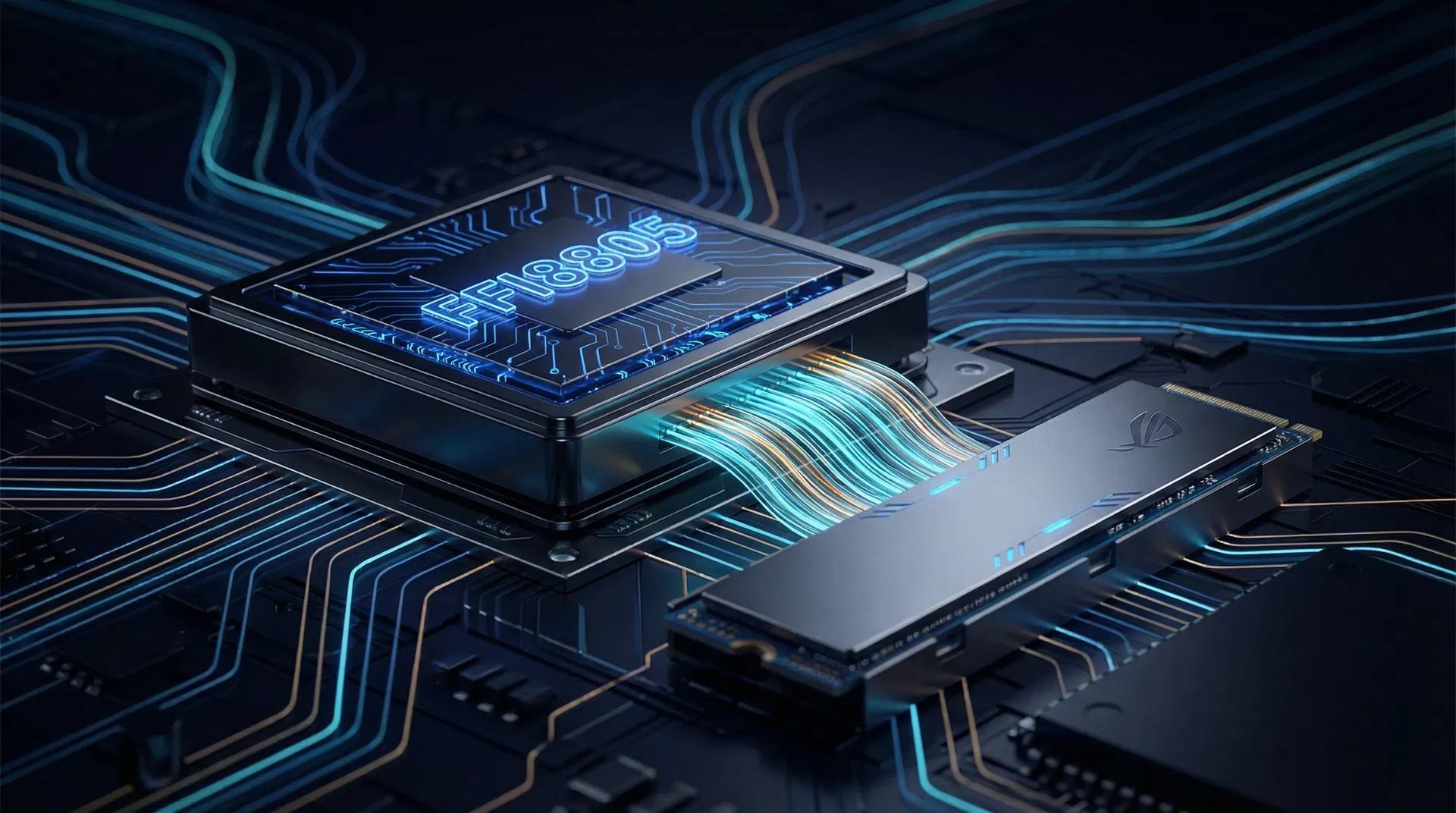

AI対応型SSD NAND IPアーキテクチャ

5層AI対応アーキテクチャはNANDアレイからアクセラレーション層まで全面的に再設計され、SSDコントローラがAIワークロードのアクセスパターンを理解します。

AIアクセスパターン認識Prefill/Decode/CheckpointのLLMアクセスパターンを自動識別し、NANDスケジューリングを動的に調整

3段バイオニックキャッシュL1 SRAM + L2 DRAM + L3 SLC 3段キャッシュ、ヒット率 β = 0.85–0.95

インテリジェントプリフェッチアテンションパターンに基づき次のKV-Cacheアクセス位置を予測し、高速キャッシュに事前ロード

ニアストレージ圧縮NANDコントローラレベルでINT4/INT8量子化解凍を実行、PCIe転送量を削減

HARDWARE SPECIFICATION

ハードウェア仕様一覧

FFI8805 Premium は CIM AI アクセラレーションコア、SSD コントローラ、NAND アレイを単一の 2.5" U.2 モジュールに統合。各サブシステムの完全な仕様を以下に示します。