杭州泓林芯驶智能科技有限公司

杭州泓林芯驶智能科技有限公司SRAM-CIM 存算一体

实现 AI 推理的最后一公里

泓林芯驰以 SRAM-CIM 核心架构打造 FFI8805 即插即用边缘 AI 平台,

用成熟工艺实现极致能效,打通 Edge AI 大规模落地的最后一公里

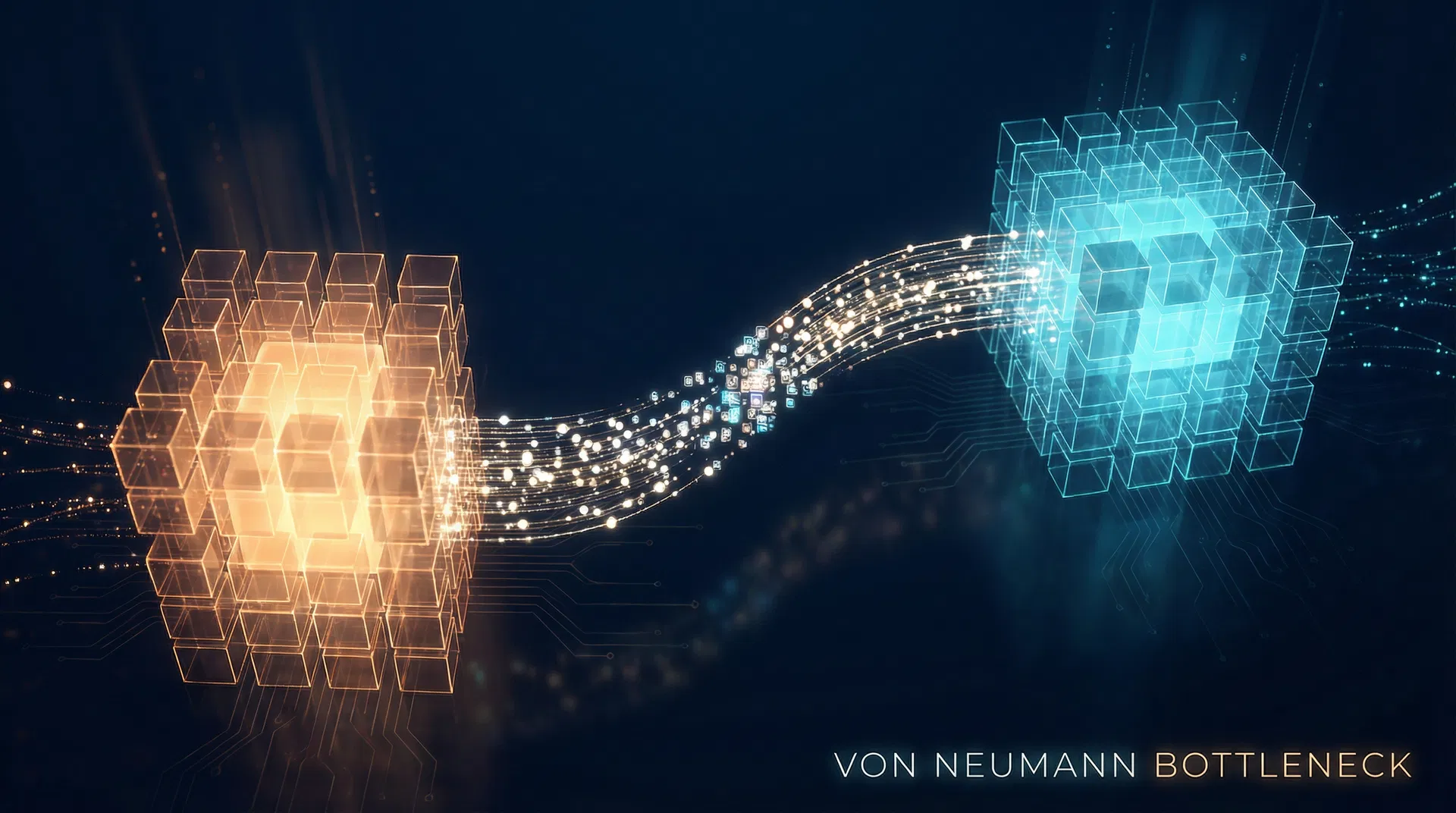

突破冯诺依曼架构的 内存墙

传统的冯诺依曼(von Neumann)运算架构将处理器与内存分离,数据需在两者间频繁传输,形成所谓的「内存墙」瓶颈。随着 AI 模型规模爆炸性增长,数据搬运的延迟与功耗已成为限制 AI 算力提升的关键枷锁。

为此,「存算一体」(Computing In Memory, CIM)技术应运而生。其核心理念是在内存单元内直接执行计算,将数据存储与逻辑运算在物理层面高度整合,从根本上消除数据来回搬运的开销。

核心概念:让计算在数据驻留之处即时发生,而非将数据搬运至处理器——这是对「计算本质」的重新定义。

冯诺依曼瓶颈示意:处理器(暖色)与内存(冷色)间的数据通道成为性能瓶颈

冯诺依曼架构 vs CIM 架构

点击切换,比较两种架构的数据处理流程差异

数据需在处理器与内存之间反复搬运,造成延迟与功耗瓶颈

CIM 技术发展历程

冯诺依曼架构诞生

处理器与内存分离的经典运算范式确立,奠定现代计算机基础。

内存墙问题浮现

AI 模型规模急速膨胀,数据搬运的延迟与功耗成为算力提升的关键瓶颈。

CIM 技术兴起

存算一体概念从学术走向产业,多家厂商开始投入 SRAM-based CIM 芯片研发。

产业化落地加速

联发科天玑 9500 导入 CIM 架构,NVIDIA 斥资 200 亿美元取得 Groq LPU 技术授权。

多架构并行时代

CIM 量产渗透率预计突破 35%,AI 芯片正式进入 LPU、GPU、TPU 多架构并行的新世代。

AI 边缘运算的 赋能者

FFI8805 基于 SRAM-CIM 存内运算架构,以低于 1W 的功耗实现高效 AI 推理,提供即插即用的标准化模组方案,协助客户将开发周期从 12 周缩短至 4 周。

CIM 技术赋能各类边缘 AI 装置:手机、穿戴设备、自驾传感器、工业 IoT

FFI8805 Mini

轻量级视觉与语音识别模组

FFI8805 Pro

小语言模型 (SLM) 与分层推理模组

AI 芯片市场趋势与预测

2020–2030 年全球 AI 芯片市场规模与 CIM 渗透率预估

- 市场规模(十亿美元)

- CIM 渗透率(%)

数据来源:综合 Gartner、IDC、TrendForce 等研调机构预估

Edge AI 落地的 三大痛点

Edge AI 的大规模落地面临三大痛点:部署整合难(软硬件规格不一,整合周期长达数月)、云端成本高(即时性差且有隐私疑虑)、运维成孤儿机(设备分散各地,缺乏 OTA 与远程诊断)。据 Gartner 统计,85% 的 Edge AI 项目因缺乏有效的生命周期管理而无法扩展。

部署整合难

软硬件规格不一,像拼装车。整合与开发周期长达数月,严重拖慢产品上市。

云端成本高

全靠云端推理运营成本高昂,即时性差且有隐私疑虑,无法大规模商业化。

运维成孤儿机

设备分散各地,缺乏 OTA 与远程诊断能力,售后维护成本极高。

CIM 架构:数据在内存阵列中流动,无需外部搬运

FFI8805 解决方案

商业模式与 生态系统

FFI 采用「硬件 + 软件订阅 + 认证生态 + IP 授权」四大支柱商业模式。

硬件模组销售

标准化 FFI8805 模组

软件订阅 SaaS

SDK 工具包 + 云端平台

认证生态系

FFI-Ready 兼容认证

IP 授权

核心架构技术授权

硬件模组销售

标准化 FFI8805 模组

软件订阅 SaaS

SDK 工具包 + 云端平台

认证生态系

FFI-Ready 兼容认证

IP 授权

核心架构技术授权

硬件模组销售

标准化 FFI8805 模组

软件订阅 SaaS

SDK 工具包 + 云端平台

认证生态系

FFI-Ready 兼容认证

IP 授权

核心架构技术授权

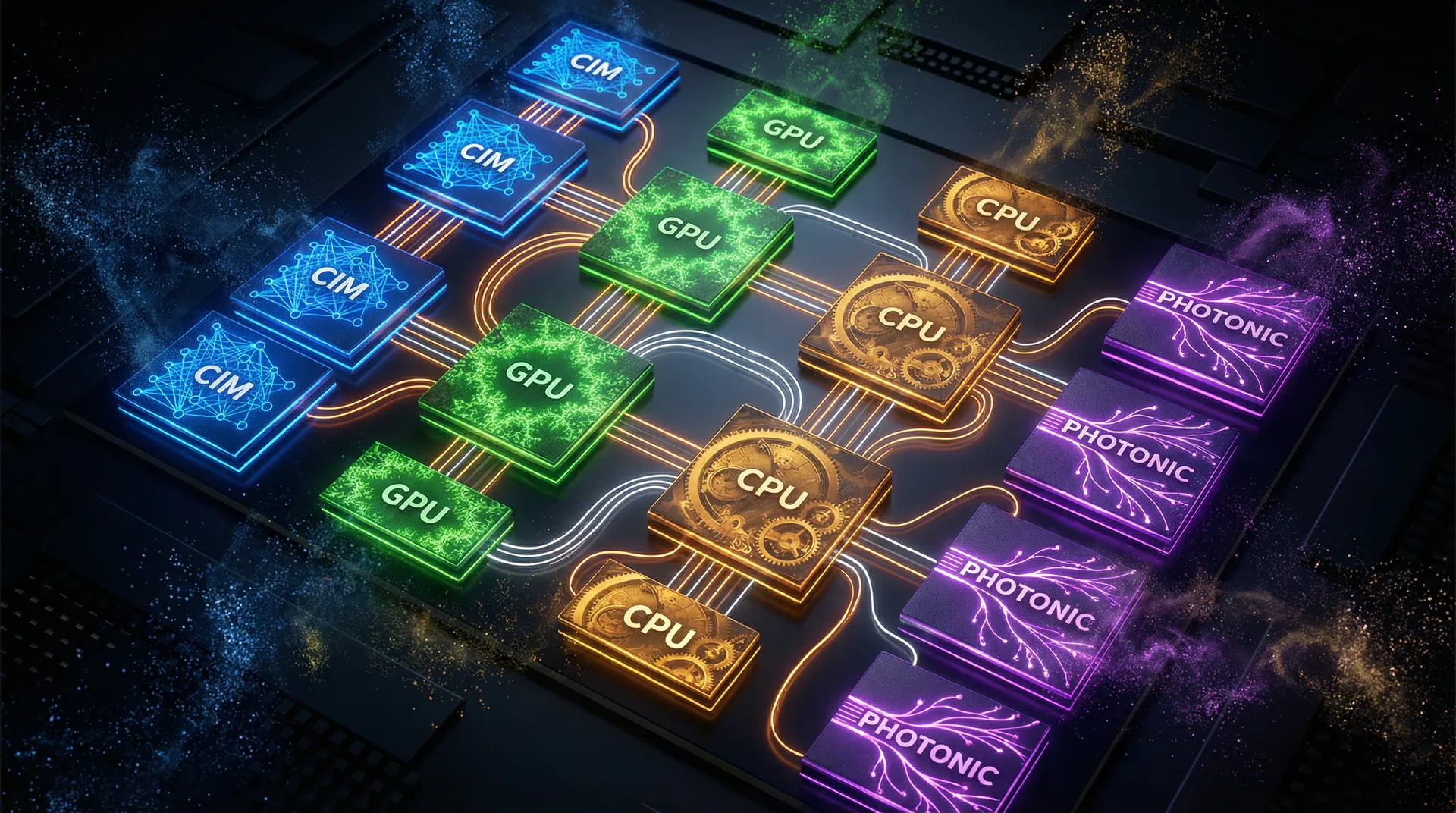

异构融合系统:CIM(蓝)、GPU(绿)、CPU(金)、光计算(紫)各司其职,通过先进封装技术整合

飞轮效应:FFI 平台通过正向飞轮循环驱动生态成长:更多合作伙伴 → 更多部署量 → 更高经常性收入 → 更强生态护城河。认证体系与专属开发工具链增加转换成本,提升客户长期黏着度。

技术选型指南

回答几个简单问题,我们将为您推荐最适合的 CIM 产品型号

您的主要应用场景是什么?

结论

FFI8805 平台采取「避实击虚」的竞争策略,不拼算力 (TOPS),主打能效比 (Perf/Watt),利用成熟制程 + SRAM-CIM 架构提供极致性价比。

聚焦破碎化市场:锁定 IPC、工控机、传统网关 (Gateway) 升级需求,提供 Turnkey Solution 与标准模组,让 Dumb Devices 通过 USB/M.2 升级为 AI Devices。通过标准化接口定义 Edge AI 的 USB,软件黏着度通过云端运维 (OTA) 与预训练模型库建立用户迁移成本。

FFI8805 不仅是芯片供应商,更是 Edge AI 基础设施的关键规格制定者。通过 Open CIM Alliance (OCA) 联盟共识与 ARM 共同定义标准,形成平台级生态系统,通过解决大厂无法解决的碎片化问题并与巨头共生形成平台。

| 竞争维度 | FFI8805 (OCA) | 传统 AI 加速器 | FFI 优势 |

|---|---|---|---|

| 核心架构 | SRAM-CIM 存内运算 | 传统 GPU/NPU 架构 | 极致能效比 |

| 整合方式 | 即插即用标准模组 | 定制化开发、长周期 | 4 周部署 vs 12 周+ |

| 运维能力 | SaaS 云端 OTA + 远程诊断 | 缺乏统一运维平台 | 降低 60% 运维成本 |

| 生态系统 | OCA 开放联盟 + FFI-Ready 认证 | 封闭生态、锁定效应 | 开放标准降低门槛 |