杭州泓林芯馳智能科技有限公司

杭州泓林芯馳智能科技有限公司SRAM-CIM 存算一體

實現 AI 推理的最後一哩路

泓林芯馳以 SRAM-CIM 核心架構打造 FFI8805 隨插即用邊緣 AI 平台,

用成熟工藝實現極致能效,打通 Edge AI 大規模落地的最後一哩路

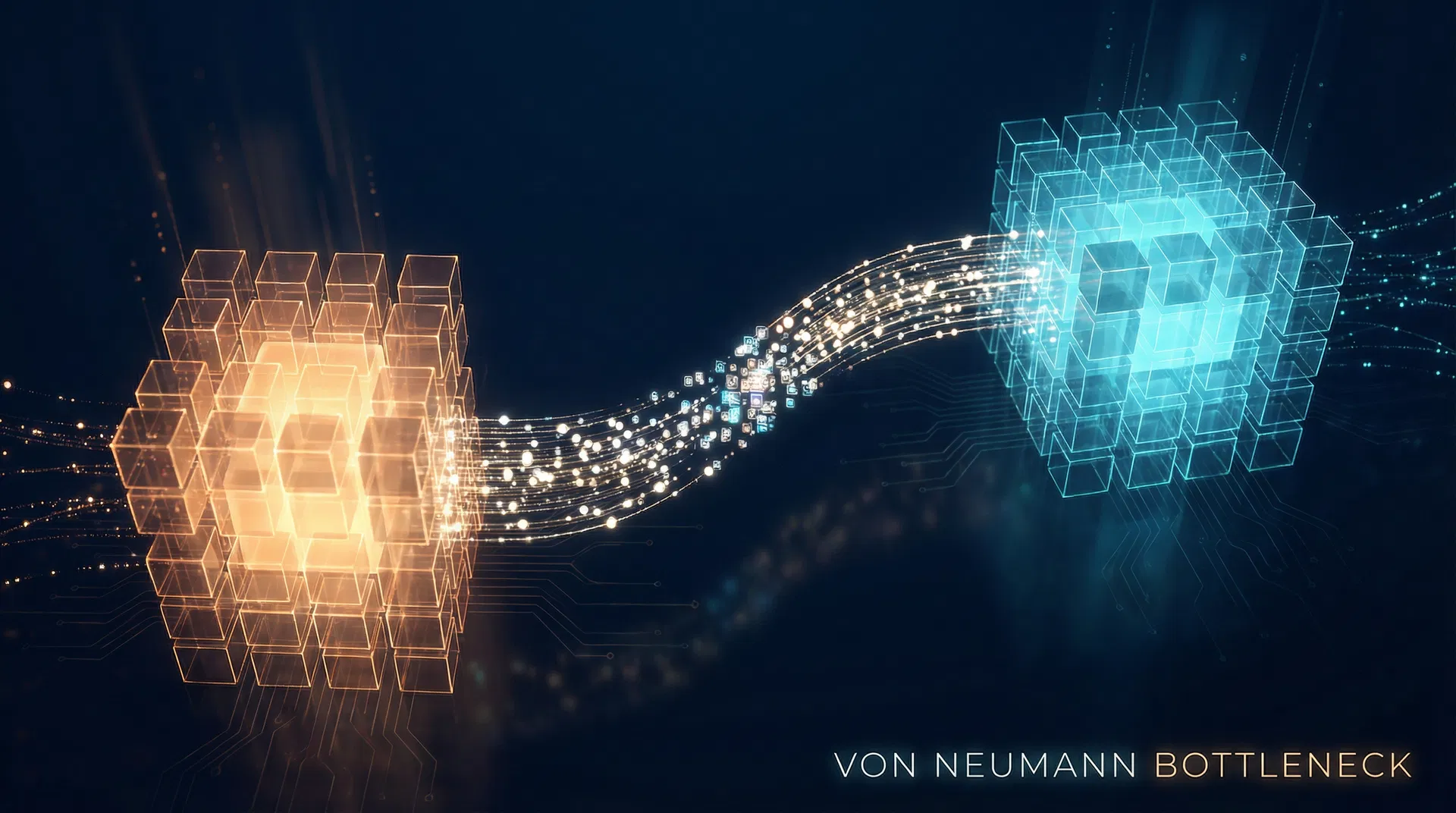

突破馮紐曼架構的 記憶體牆

傳統的馮紐曼(von Neumann)運算架構將處理器與記憶體分離,數據需在兩者間頻繁傳輸,形成所謂的「記憶體牆」瓶頸。隨著 AI 模型規模爆炸性增長,數據搬運的延遲與功耗已成為限制 AI 算力提升的關鍵枷鎖。

為此,「存算一體」(Computing In Memory, CIM)技術應運而生。其核心理念是在記憶體單元內直接執行計算,將數據儲存與邏輯運算在物理層面高度整合,從根本上消除數據來回搬運的開銷。

核心概念:讓計算在數據駐留之處即時發生,而非將數據搬運至處理器——這是對「計算本質」的重新定義。

馮紐曼瓶頸示意:處理器(暖色)與記憶體(冷色)間的數據通道成為效能瓶頸

馮紐曼架構 vs CIM 架構

點擊切換,比較兩種架構的數據處理流程差異

數據需在處理器與記憶體之間反覆搬運,造成延遲與功耗瓶頸

CIM 技術發展歷程

馮紐曼架構誕生

處理器與記憶體分離的經典運算範式確立,奠定現代電腦基礎。

記憶體牆問題浮現

AI 模型規模急速膨脹,數據搬運的延遲與功耗成為算力提升的關鍵瓶頸。

CIM 技術興起

存算一體概念從學術走向產業,多家廠商開始投入 SRAM-based CIM 晶片研發。

產業化落地加速

聯發科天璣 9500 導入 CIM 架構,NVIDIA 斥資 200 億美元取得 Groq LPU 技術授權。

多架構並行時代

CIM 量產滲透率預計突破 35%,AI 晶片正式進入 LPU、GPU、TPU 多架構並行的新世代。

AI 邊緣運算的 賦能者

FFI8805 基於 SRAM-CIM 存內運算架構,以低於 1W 的功耗實現高效 AI 推理,提供隨插即用的標準化模組方案,協助客戶將開發週期從 12 週縮短至 4 週。

CIM 技術賦能各類邊緣 AI 裝置:手機、穿戴裝置、自駕感測器、工業 IoT

FFI8805 Mini

輕量級視覺與語音識別模組

FFI8805 Pro

小語言模型 (SLM) 與分層推理模組

AI 晶片市場趨勢與預測

2020–2030 年全球 AI 晶片市場規模與 CIM 滲透率預估

- 市場規模(十億美元)

- CIM 滲透率(%)

資料來源:綜合 Gartner、IDC、TrendForce 等研調機構預估

Edge AI 落地的 三大痛點

Edge AI 的大規模落地面臨三大痛點:部署整合難(軟硬體規格不一,整合週期長達數月)、雲端成本高(即時性差且有隱私疑慮)、維運成孤兒機(裝置分散各地,缺乏 OTA 與遠端診斷)。據 Gartner 統計,85% 的 Edge AI 專案因缺乏有效的生命週期管理而無法擴展。

部署整合難

軟硬體規格不一,像拼裝車。整合與開發週期長達數月,嚴重拖慢產品上市。

雲端成本高

全靠雲端推理營運成本高昂,即時性差且有隱私疑慮,無法大規模商業化。

維運成孤兒機

裝置分散各地,缺乏 OTA 與遠端診斷能力,售後維護成本極高。

CIM 架構:數據在記憶體陣列中流動,無需外部搬運

FFI8805 解決方案

商業模式與 生態系統

FFI 採用「硬體 + 軟體訂閱 + 認證生態 + IP 授權」四大支柱商業模式。

硬體模組銷售

標準化 FFI8805 模組

軟體訂閱 SaaS

SDK 工具包 + 雲端平台

認證生態系

FFI-Ready 相容認證

IP 授權

核心架構技術授權

硬體模組銷售

標準化 FFI8805 模組

軟體訂閱 SaaS

SDK 工具包 + 雲端平台

認證生態系

FFI-Ready 相容認證

IP 授權

核心架構技術授權

硬體模組銷售

標準化 FFI8805 模組

軟體訂閱 SaaS

SDK 工具包 + 雲端平台

認證生態系

FFI-Ready 相容認證

IP 授權

核心架構技術授權

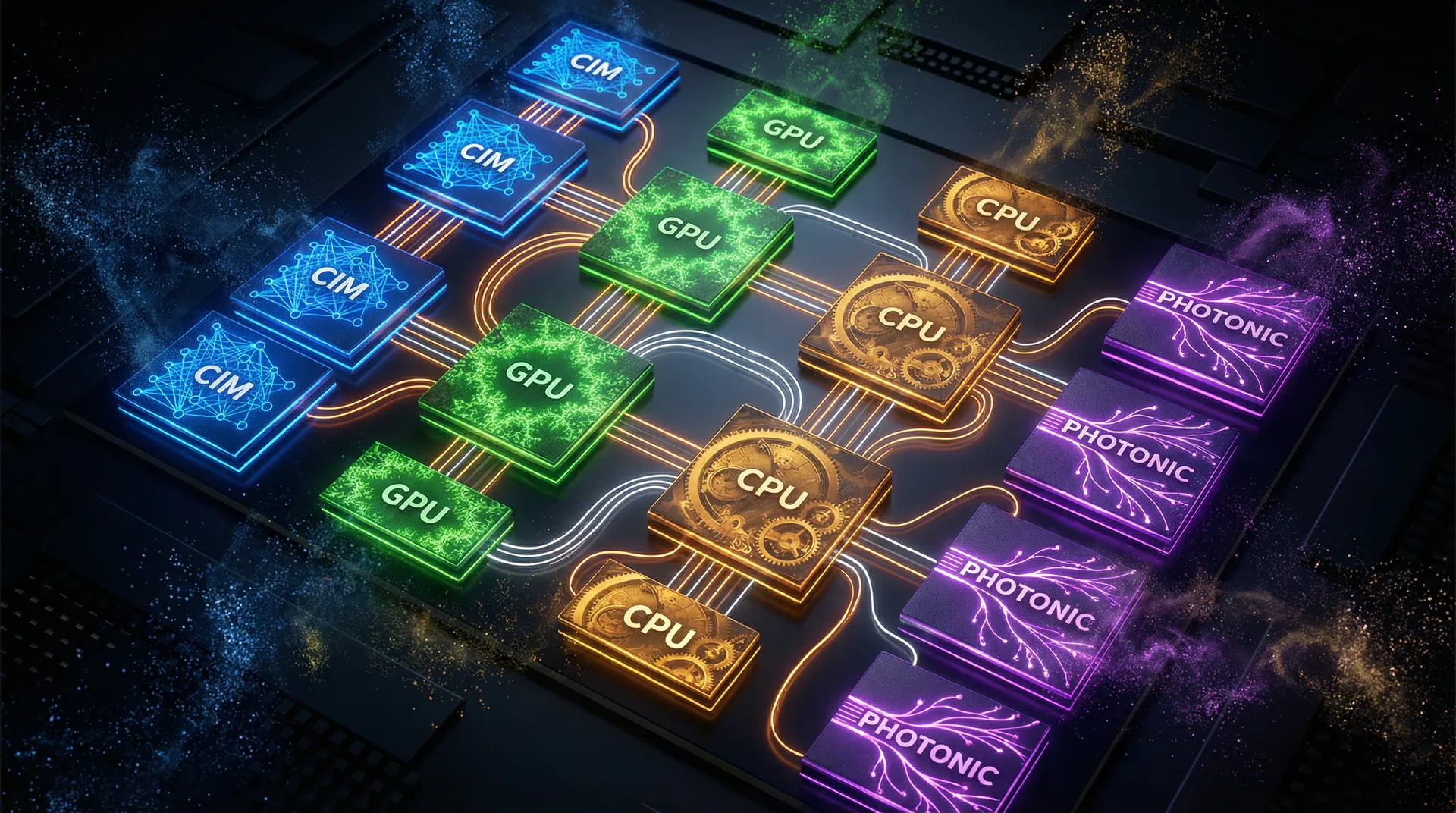

異構融合系統:CIM(藍)、GPU(綠)、CPU(金)、光計算(紫)各司其職,透過先進封裝技術整合

飛輪效應:FFI 平台透過正向飛輪循環驅動生態成長:更多合作夥伴 → 更多部署量 → 更高經常性收入 → 更強生態護城河。認證體系與專屬開發工具鏈增加轉換成本,提升客戶長期黏著度。

技術選型指南

回答幾個簡單問題,我們將為您推薦最適合的 CIM 產品型號

您的主要應用場景是什麼?

結論

FFI8805 平台採取「避實擊虛」的競爭策略,不拼算力 (TOPS),主打能效比 (Perf/Watt),利用成熟製程 + SRAM-CIM 架構提供極致性價比。

聚焦破碎化市場:鎖定 IPC、工控機、傳統閘道器 (Gateway) 升級需求,提供 Turnkey Solution 與標準模組,讓 Dumb Devices 透過 USB/M.2 升級為 AI Devices。透過標準化介面定義 Edge AI 的 USB,軟體黏著度透過雲端維運 (OTA) 與預訓練模型庫建立用戶遷移成本。

FFI8805 不僅是晶片供應商,更是 Edge AI 基礎設施的關鍵規格制定者。透過 Open CIM Alliance (OCA) 聯盟共識與 ARM 共同定義標準,形成平台級生態系統,透過解決大廠無法解決的碎片化問題並與巨頭共生形成平台。

| 競爭維度 | FFI8805 (OCA) | 傳統 AI 加速器 | FFI 優勢 |

|---|---|---|---|

| 核心架構 | SRAM-CIM 存內運算 | 傳統 GPU/NPU 架構 | 極致能效比 |

| 整合方式 | 隨插即用標準模組 | 客製化開發、長週期 | 4 週部署 vs 12 週+ |

| 維運能力 | SaaS 雲端 OTA + 遠端診斷 | 缺乏統一維運平台 | 降低 60% 維運成本 |

| 生態系統 | OCA 開放聯盟 + FFI-Ready 認證 | 封閉生態、鎖定效應 | 開放標準降低門檻 |