繁體中文

Traditional Chinese

0%

任務完成時間降低

1%

推理吞吐量提升

9

GPU 可擴展規模

0%

能效比提升

LLM 推理面臨的三大瓶頸

隨著 DeepSeek V4 等超大規模模型參數突破兆級,傳統 GPU + DRAM 架構在記憶體容量、存儲頻寬與運營成本三方面同時遭遇瓶頸。

記憶體牆

671B 參數模型需 1.2TB+ 記憶體,單機 GPU HBM 容量遠遠不足,KV-Cache 隨上下文長度線性膨脹。

存儲頻寬瓶頸

Prefill 階段需從 SSD 載入數百 GB 模型權重,傳統單路 PCIe 頻寬成為推理延遲的主要瓶頸。

運營成本

大規模 GPU 叢集的電力與散熱成本持續攀升,每 Token 推理成本難以降低至商業可行水平。

CORE TECHNOLOGIES

三大核心技術支柱

FFI8805 Premium 融合三項突破性技術,從模型記憶、數據通路到存儲介質全面優化 LLM 推理效能。

PILLAR 1 · MODEL MEMORY

DeepSeek V4 Engram 永久記憶引擎

Engram 是 DeepSeek V4 引入的原生永久記憶機制,將高頻知識壓縮為 O(1) 可查詢的結構化記憶體,取代傳統 KV-Cache 的線性增長模式。結合 MLA v2 多頭潛在注意力與 FP8 混合精度訓練,在 14.8T Token 語料上實現全面超越 V3 的性能。

O(1)

記憶查詢複雜度

14.8T

訓練 Token 數

5.2×

記憶壓縮比

671B

模型參數量

V4 vs V3 基準提升

MMLU+3.4

BBH+5.0

HumanEval+3.0

MATH+2.4

Multi-Query NIAH+12.8

PILLAR 2 · DATA PATH

DualPath 雙路頻寬優化

DualPath 技術利用 AI 訓練叢集中閒置的 DE(數據引擎)節點 SNIC 網卡,開闢第二條 SSD→DE DRAM→CNIC RDMA→GPU 的數據通路。在 Prefill 階段,雙路並行讀取模型權重,突破傳統單路 PCIe 的頻寬天花板。

45.62%

JCT 降低

2.25×

吞吐量提升

1,152

GPU 規模

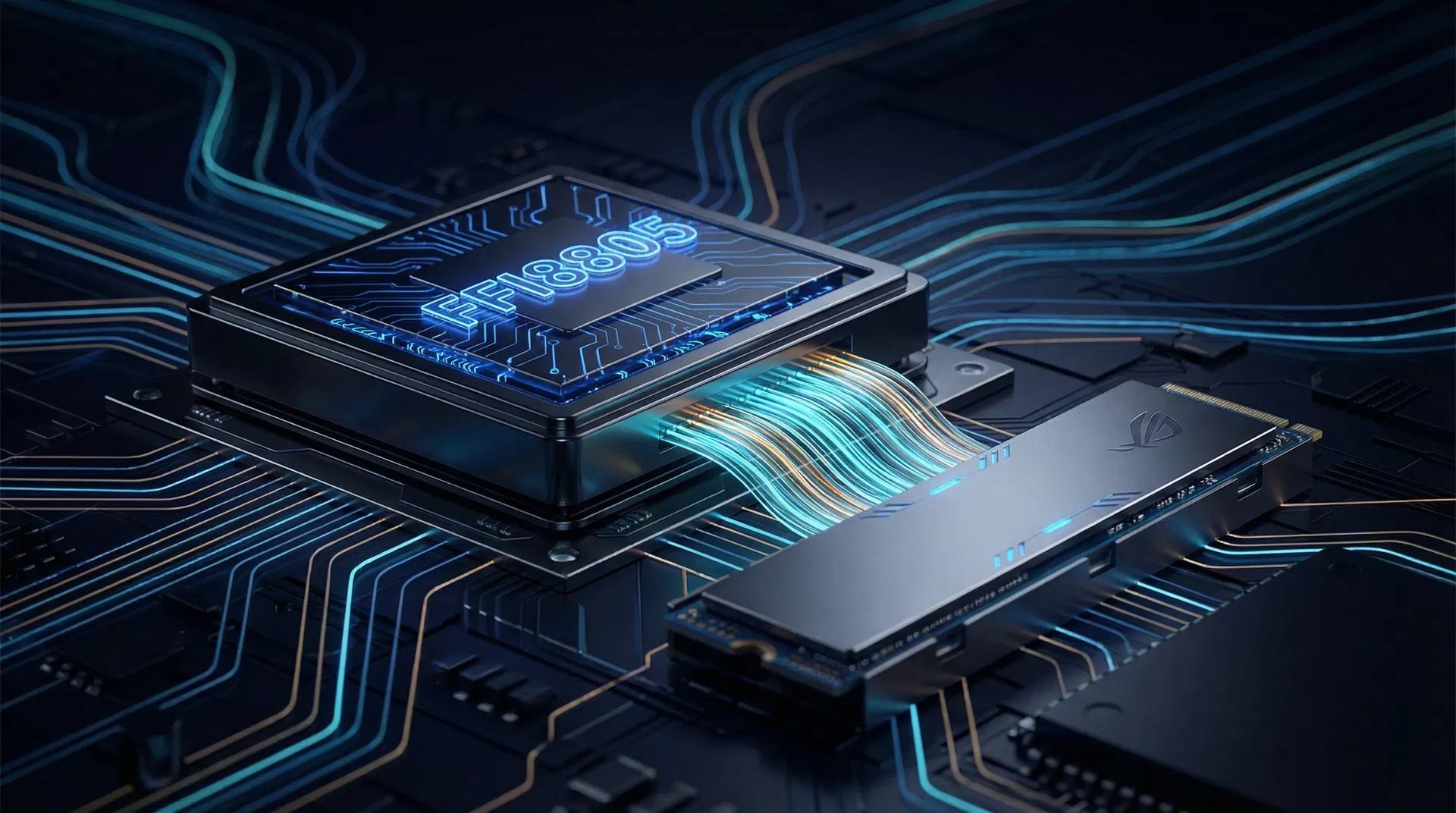

PILLAR 3 · STORAGE MEDIA

AI 感知型 SSD NAND IP 架構

五層式 AI 感知架構從 NAND 陣列到加速層全面重新設計,讓 SSD 控制器理解 AI 工作負載的存取模式,實現智慧預取、動態 QoS 與近存儲計算。

AI 存取模式識別自動辨識 Prefill / Decode / Checkpoint 三種 LLM 存取模式,動態調整 NAND 排程策略

三級仿生快取L1 SRAM + L2 DRAM + L3 SLC 三級快取,命中率 β = 0.85–0.95

智慧預取引擎基於注意力模式預測下一批 KV-Cache 存取位置,提前載入至高速快取

近存儲壓縮在 NAND 控制器層級執行 INT4/INT8 量化解壓,減少 PCIe 傳輸量

HARDWARE SPECIFICATION

硬體規格總覽

FFI8805 Premium 整合 CIM AI 加速核心、SSD 控制器與 NAND 陣列於單一 2.5" U.2 模組中,以下為各子系統的完整規格。